Università

degli Studi di Udine -a.a. 2004/05 - Facoltà di Scienza della

Formazione

Laurea Triennale

" Scienze e tecnologie multimediali" - Pordenone

Teorie e Tecniche dei nuovi media- dott. Antonella Varesano

LEZ. 1 I NUOVI MEDIA

I materiali pubblicati iin questo sito sono coperti da copyright e riguardano alcuni approfondimenti dei testi d'esame che ovviamente hanno bisogno o del testo o della frequenza per essere compresi, si invita gli studenti non frequentanti ad andare a visionare i link suggeriti.

Durante le lezioni in aula dovremo sempre ricordare che per analizzare correttamente i nuovi media ci sono cinque storie che si svolgono in parallelo e spessissimo si sovrappongono:

- la prima narra dello sviluppo teorico delle nuove tecnologie

- la seconda dello sviluppo tecnico dei dispositivi

- la terza riguarda l'analisi critica sulla nuova società e sui linguaggi e della comunicazione

- la quarta si occupa della ricerca e dell'arte che ha contribuito a creare questi linguaggi

- la quinta, ma non di certo l'ultima, riguarda gli aspetti politico economici.

in ognuna di queste storie ci sono altrettanti piani di sovrapposizione che risultano difficili di scogliere e da identificare, ma tutti questi aspetti concorrono alla creazione di quell'universo che oggi ha preso forma diventando l'attuale panorama dele tecnologie per l'informazione e la comunicazione.

NUOVI MEDIA un nuovo modello di pensiero

COME SONO NATI I NUOVI MEDIA?

MEMEX 1945

per approfondire gli argomenti relativi a Vannevar Bush ed il Memex leggere i seguenti articoli:

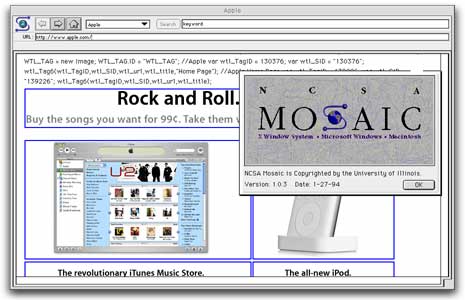

INTERNET e il WWW - dal 1966 alla rivoluzione del 1989

per approfondire gli argomenti relativi allo storia di interenet, del www e del prmo browser

2. TECNICA - LO SVILUPPO TECNOLOGICA e la RIVOLUZIONE DIGITALE

SCHEMA GENERALE - TAPPE dell' INFORMATICA

| GENERAZIONE DI CALCOLATORI | ANNO | caratteristiche tecniche | caratteristiche software |

| MARK 1 | 1943 | relè elettromagnetico | circuiti di calcolo a predisposizione manuale |

| I GENERAZIONE | 1946-57 | calcolatori a valvole | linguaggio macchina |

| II GENERAZIONE | 1955-64 | transistor e dischi magnetici | linguaggi alto livello |

| III GENERAZIONE | 1965-74 | circuiti integrati | multiprogrammazione |

| IV GENERAZIONE | 1975-80 | semiconduttori | sist. operativi iconici circuiti alta integrazione |

| V GENERAZIONE | 1980 | circuiti altissima integrazione | sistemi esperti, RV, MULTIMEDIALITA' |

Computer Museum History Center

L'invenzione del microprocessore rese possibile l'avvento della terza generazione. La storia del microprocessore inizia nel 1971 con l'Intel 4004, seguito dopo breve tempo dal più celebre 8080. I primi prototipi di microcomputer vennero realizzati nel 1973 nei laboratori della Digital ma non vennero mai commercializzati, dato che, ragionando con gli schemi centralistici della seconda informatica, nessuno degli ingeneri addetti alla definizione delle strategie di produzione poteva immaginare delle applicazioni per un computer di capacità così ridotte.

Con

il termine 'rivoluzione digitale' si definisce la trasformazione avvenuta

principalmente a livello tecnologico, ma anche sociale, grazie alla massiccia

introduzione di tecnologie definite appunto digitali.

Tale introduzione è stata possibile grazie all'invenzione e la

diffusione del microprocessori, che dagli anni '70 ad oggi hanno talmente

potenziato i computer permettendo di trasformare i dati, provenienti da

apparecchiature analogiche, in numeri. La potenza del digitale è

proprio questa, trasformare il CONTINUO in DISCRETO, quando infatti i

dati (testi, suoni, immagini, video) sono trasformati in numeri è

possibile manipolarli allo stesso modo permettendo operazioni fino ad

allora impossibili come tagliare, incollare, duplicare, allungare, accorciare,

dilatare, ecc.

Nello stesso anno Johnathan Titus, un giovane ingegnere appassionato di elettronica, costruì il primo microcomputer commercializzato, una macchina grande come una scatola per scarpe dotata di un microprocessore Intel 8080 e di una memoria pari a 8 volte 256 bit, estensibile a 16 Kbit. La macchina, quanto mai primitiva e difficile da usare, visualizzava gli output su un display frontale a punti luminosi, i dati di input dovevano essere introdotti uno a uno in linguaggio binario e non era dotata di memoria di massa per cui tutti i dati venivano cancellati quando si staccava la spina dalla presa di corrente. Titus pubblicò i piani della sua macchina sulla rivista RadioElectronics nel luglio del 1974, e si offrì di vendere per corrispondenza il kit per costruirla da soli.

Era nato il Mark 8, il primo "minicomputer personale". Il primo personal computer prodotto commercialmente fu l'Altair 8800, nel 1975, sempre basato su un processore 8080. La strada verso l'affermazione del personal computer era ormai aperta: il primo Apple II venne prodotto e commercializzato nel 1977 e il primo PC Ibm nel 1981.

foto storiche dei computer al sito --- www.hongwanjihi.org/Web2003/links/compHist/pictures.htm

Nell XXI secolo invece, biologia e chimica molecolare stanno per entrare prepotentemente nell'informatica. E' possibile concepire una sostituzione dei transistor al silicio con elementi basati su molecole organiche (catene di carbonio, idrogeno e ossigeno), i quali svolgerebbero la stessa funzione dei primi (interruttori a due stati, zero e uno), con il vantaggio di essere molto più piccoli e di dissipare una potenza praticamente nulla. Un simile dispositivo, già battezzato nanocomputer, rivoluzionerebbe il mondo dei microprocessori e aprirebbe la strada ad una integrazione tra tessuti nervosi organici e macchine artificiali elaboratrici di informazioni con conseguenze che per il momento non siamo in grado di immaginare.

per una panoramica molto vasta sulle reti neurali - www.hyperlabs.net/neurale/introduzione/

INTELLIGENZA ARTIFICIALE

A partire dagli anni '50 nasce una nuova disciplina scientifica, l' Intelligenza Artificiale per la quale si usa la sigla abbreviata A. I. nella lingua inglese.

L'assunto di base della A. I. è il seguente:

il ragionamento dell'uomo in ultima analisi si può definire una forma di calcolo che manipola ed elabora simboli ed idee.

Gia' del '600 Hobbes scriveva nel Leviatano " Ragionare non è altro che calcolare "

I concetti alla base della A.I. oggi sono ancora gli stessi

L'

A. I. viene anche definita una branca della scienza dei calcolatori ma

il suo obiettivo di studio e' il seguente:

l'indagine sui meccanismi saggiacenti alle facolta'

cognitive degli esseri umani, quali il linguaggio, il ragionamento, la

capacità dirisolve problemi e la percezione.

Con il passare degli anni la disciplina ha incontrato varie difficolta' e si e' divisa in due aree di pensiero:

1. l'intelligenza artificiale forte convinta che un computer opportunamente programmato possa essere dotato di una intelligenza non distinguibile da quella umana

2. l' intelligenza artificiale debole convinta che un computer opportunamente programmato possa solo simulare i processi cognitivi umani

Il TEST di Turing

Si tratta di un gioco in grado ci sostituire la domanda astratta "possono pensare le macchine?"

prova a giocare con la macchina

Il PROBLEMA DEL SIGNIFICATO

L'A.I. classica sostiene che le facoltà cognitive di un agente intelligente derivino dalla sua natura di manipolatore automatico di simboli.

Ma per quanto riguarda le computazioni cio' che conta e' solo la forma dei simboli e delle configurazioni di simboli, ovvero la sintassi. Il problema secondo Searle consiste nel fatto che i computer ELABORA SIMBOLI DI CUI NON CONOSCE IL SIGNIFICATO.

IL PENSIERO NON E' IL PRODOTTO DI PROCESSI COMPUTAZIONALI SIMBOLICI MA EMERGE DAL COMPORTAMENTO COMPLESSIVO DI UNITA' SUBSIMBOLICHE CHE PRESE SINGOLARMENTE NON RAPPRESENTANO NULLA.

RETI NEURALI e Connessionismo

Cio' che conta in un computer, al di la' del tipo di materiale che lo compone, leve, ruote, valvole, transistor, silicio, ecc e' la stuttura formale e funzionale. Nonostante i 50 anni di ricerche e sperimentazioni l' A. I.classica non è riuscita a costruire dei modelli computazioniali delle varie facoltà cognitive umane quindi a partire alla fine degli anni 70 e' sorta una nuova impostazione nello studio della mente che si chiama connessionismo. Il fondamento teorico del connessionismo e' il seguente: per spiegare o riprodurre l'intelligenza e tutte le facolta' cognitive di un essere umano e' necessario emulare le proprietà fisiologiche del cervello, ovvero il funzionamento delle cellule.

Le ricerche piu' avanzate nel campo delle neuroscienze hanno cercato quindi di emulare il comportamento delle cellule neuronali facendo ricorso alle RETI NEURALI . Una rete neurale è un insieme di nodi collegati sia in input che output e i nodi possono assumere due stati - RIPOSO o ATTIVAZIONE. Il comportamento di una rete neurale e' descritto come un processo in cui, fornito uno stimolo come imput la rete rilascia una configurazione di segnali diversa che si dipana all'interno della sua architettura. I nodi infatti si dispongono su piu' strati in cui le reti sono connesse con funzioni diverse.

A differenza quindi

dai computer digitali le reti neurali funzionano a MODALITA' PARALLELA

quindi molti nodi cambiano i loro stato simultaneamente. Questo tipo di

elaborazione sembra avvicinarsi molto al funzionamento del cervello mentre

le macchine di Touring e di Von Neuman elaborano un modello di tipo sequenziale.

La proprieta' che pero' si dimostra piu'interessante e' che queste rete

hanno una capacta' di apprendimento e possono svolgere dei compiti senza

essere programmate esplicitamente, basta inserire degli stimoli adatti

a generare un tipo corrispondente di stimoli in uscita. Nelle reti neurali

inoltre la conoscenza necessaria a svolgere un determinato compito non

e' rappresentata da simboli distinti ma da elaborazioni subsimboliche.

Abbiamo tentato quindi di fornire una breve panoramica di come sono nati e come si sono diffusi i - nuovi media - per concludere che i nuovi media, a differenza dei vecchi media, sono quelli che hanno un' anima digitale.

Le riflessioni possibili su questo argomento, seppur breve ma denso di svolte significative, che ha visto la luce negli anni '40 ed ha raggiunto oggi, o sta per ranggiungere, una portata planetaria contengono al loro interno un paradosso. L'HARDWARE é stato superato dal SOFTWARE.

La rete - internet - finalmente incarna quello che i grandi teorici avevano precorso, tutte le sue caratteristiche: connettività, ipertestualità, intertestualità ne hanno favorito l'utilizzo in un' inarrestabile crescita esponenziale in grado di produrre un' 'intelligenza collettiva' e un sapere circolare che testimoniano da tempo la produzione di un 'luogo di produzione di senso'.

Eppure i computer di oggi sono solo a livello di sistemi e di supporto - multimediali o multicodici - ma in realtà la loro struttura e la loro modalità di funzionamento rimane sequenziale e fondamentalmente gerarchica. Il vero salto è riposto nel 'connessionismo' che vuole potenziare a tal punto la macchina da farla diventare un'organismo in divenire dotato di una struttura associativa.

approfondimenti:

Bolter J. D. - L'uomo di Turing. La cultura occidentale nell'età del computer- Pratiche - Parma 1984

Ciotti F, Boncaglia G. - Il mondo digitale - Editori Laterza - Bari 2000

Ciotti F, Boncaglia G. - Frontiere di rete. Internet 2001 - Editori Laterza - Bari 2001

Malcolm G. - Understanding Hypermedia 2000 - Phaidon - London 1998

Mantovani G. (1995), Comunicazione e identità. Dalle situazioni quotidiane agli ambienti virtuali, Bologna, Il Mulino

Nelson T.H. - Literary Machines- Muzzio - Padova 1992

Nyce J, Kahn P.- Da Memex a Hypertext - Muzzio - Padova 1992

Packer R., Jordan K. - Multimedia. From Wagner to virtual reality - ed W W Norton Co.- New York

Stone

A. R. (1996), The War of Desire and Technology at the Close of the Mechanical

Age, Cambridge (Mass.), Mit Press

Turkle S. (1997), La vita sullo schermo, Milano, Apogeo